PyTorch学习

发布于2019-08-07 14:54 阅读(1201) 评论(0) 点赞(2) 收藏(3)

PyTorch

英文手册 https://pytorch.org/docs/stable/index.html

中文手册推荐使用 https://pytorch-cn.readthedocs.io/zh/latest/

搬砖的学习

- 预训练模型 https://www.cnblogs.com/wmlj/p/9917827.html

- forward函数 https://blog.csdn.net/u011501388/article/details/84062483

- 使用nn.Sequential类来自定义顺序连接模型 https://blog.csdn.net/qq_27825451/article/details/90551513

1.nn.Sequential直接设置层连接整个模型 2. 使用.add_module进行添加层 - 使用nn.Module类来自定义层,模型,进行训练,了解整个项目的过程,非常赞 https://blog.csdn.net/qq_27825451/article/details/90550890

https://blog.csdn.net/qq_27825451/article/details/90705328

PyTorch常见小问题

- 输入的图像数据进行转置,即原图

H x W x C,Pytorch的Tensor为C X H X W(搞笑问题)num_workers:使用多进程加载的进程数,0代表不使用多进程

PyTorch框架Train分析

PyTorch数据集

Dataset 类:

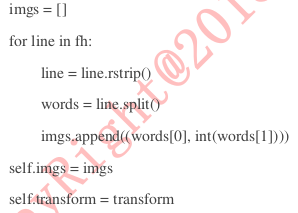

- _getitem_函数,getitem 接收一个 index,然后返回图片数据和标签,这个index 通常指的是一个 list 的 index,这个 list 的每个元素就包含了图片数据的路径和标签信息。

- 构建Dataset的子类(将其存到一个list的一行中,然后循环),然后就可以吧数据放到DataLoder中,然后访问getiterm函数读取标签+图像,然后拼成一个Batch,输入到模型中。

PyTorch模型

- 继承 nn.Module 这个类

- 在

__init__(self)中设置好需要的“组件"(如 conv、pooling、Linear、BatchNorm等) (3)在 forward(self, x)中用定义好的“组件”进行组装,def forward(self, x):,x 为模型的输入

nn.Sequetial就是一个可以按照顺序封装初始化层的容器

权值初始化

- 基础步骤:先设定什么层用什么初始化方法,实例化一个模型之后,执行该函数,即可完成初始化。

- 按需定义初始化方法,例如:

if isinstance(m, nn.Conv2d):

n = m.kernel_size[0] * m.kernel_size[1] * m.out_channels

m.weight.data.normal_(0, math.sqrt(2. / n))

PyTorch代码小手册

torch

torch.sum(input, dim, out=None)→ Tensor #与python中的sum一样

input (Tensor) – 输入张量

dim (int) – 缩减的维度,开始的时候不理解为什么英文文档里面会说这是缩减的维度,对于高维度的数组如(QxWxExR),对dim=1进行sum,那么其得到的维度就是QxExR,保留最高维度Q的形状,对W维度对应最小的元素进行求和,所以W维度就会消失,其他的函数的维度处理也是这样理解。

out (Tensor, optional) – 结果张量

print(x.sum(0))#对一维的数求和,按列求和

print(x.sum(1))#对二维求和按行求和

print(x.sum(2))#将最小单位的数组元素相加即可new_features = super(_DenseLayer, self).forward(x)

最后在官方论坛上得到结果,含义是将调用所有add_module方法添加到sequence的模块的forward函数。torch.where(condition, x, y) → Tensor对于x而言,如果其中的每个元素都满足condition,就返回x的值;如果不满足condition,就将y对应位置的元素或者y的值torch.narrow(input, dimension, start, length)张量剪裁permute把张量变换成不同维度,view相当于reshape,将元素按照行的顺序放置在新的不同大小的张量当中torch.cat(tensors, dim=0, out=None) → Tensor将张量按照维度进行衔接torch.gesv(B, A, out=None) -> (Tensor, Tensor)是解线性方程AX=B后得到的解- (1)

torch.unsqueeze(input, dim, out=None) → Tensor在指定位置增加一个一维的维度

dim (int) – the index at which to insert the singleton dimension

(2)torch.squeeze(input, dim, out=None) → Tensor在指定位置减去一个一维的维度,默认()就是把所有shape中为1的维度去掉 detach()就是取出一个该个tensor,并且它不会再参与梯度下降

torch.nn

nn.Sequential一个有序的容器,神经网络模块将按照在传入构造器的顺序依次被添加到计算图中执行,同时以神经网络模块为元素的有序字典也可以作为传入参数。torch.nn.functional.grid_sample(input, grid, mode='bilinear', padding_mode='zeros')将其归一化到一个(-1,1)的二维平面上,outpuy_{x,y} 的像素值与input_{x0,y0} 的像素值一致, 矩阵索引通过grid矩阵保存。 grid_{x,y}=(x0,y0)

参考网站 https://blog.csdn.net/houdong1992/article/details/88122682

英文手册原文 https://pytorch.org/docs/stable/nn.html?highlight=grid_sample#torch.nn.functional.grid_sample

PyTorch_Tools

- torchsummary

#Sample:

import torch, torchvision

from torchsummary import summary

model = torchvision.models.vgg16()

summary(model, (3, 224, 224))

学习小结

2019.7.9更新:最近接触新的论文和模型框架,梳理了一下整个学习过程:第一步是读懂论文关于整个框架的布置,知道数据是如何变化的,比如是否降分辨率,维度变化,属于分类还是拟合、聚类,找出核心和疑惑的点;第二步读懂代码在这个框架下,数据要如何预处理(需要结合特殊要求做变化),清楚核心和疑惑的点;第三步梳理整个过程,形成和完善文档;第四步改模型,调参啊敲代码之类的就是以后的事情了····

所属网站分类: 技术文章 > 博客

作者:pinggo

链接:https://www.pythonheidong.com/blog/article/11403/494617cefe2dccf2bea3/

来源:python黑洞网

任何形式的转载都请注明出处,如有侵权 一经发现 必将追究其法律责任

昵称:

评论内容:(最多支持255个字符)

---无人问津也好,技不如人也罢,你都要试着安静下来,去做自己该做的事,而不是让内心的烦躁、焦虑,坏掉你本来就不多的热情和定力