ResNet的bottlenet编写以及网络层数的理解

发布于2019-08-17 21:37 阅读(1616) 评论(0) 点赞(3) 收藏(3)

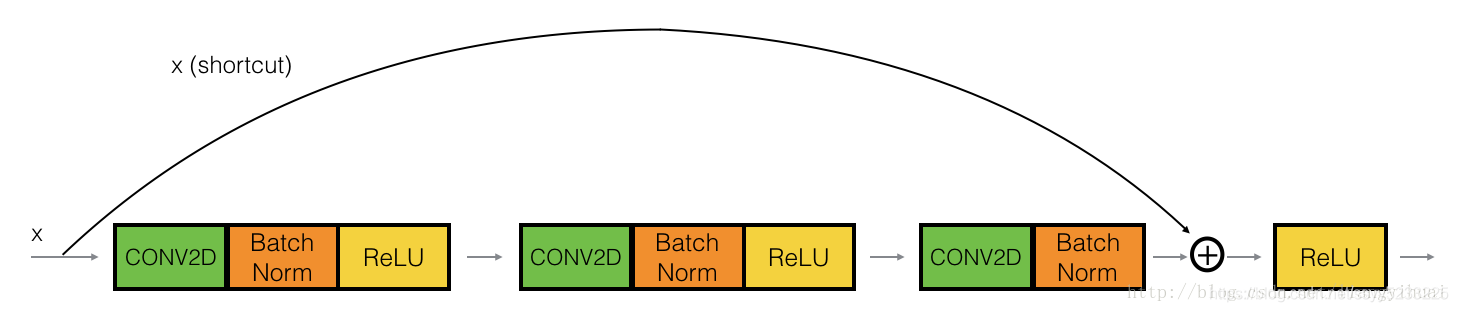

1、ResNet残差网络的bottlenet结构

代码编写如下:

regul = regularizers.l2(l2)

optim = Adam(lr=lr)

kwargs = {'padding':'same', 'kernel_regularizer':regul}

bottlenet:

def subblock(x, filter, **kwargs):

x = BatchNormalization()(x)

y = x

y = Conv2D(filter, (1, 1), activation='relu', **kwargs)(y) # 减少特征数量

y = BatchNormalization()(y)

y = Conv2D(filter, (3, 3), activation='relu', **kwargs)(y) # 扩展特征域

y = BatchNormalization()(y)

y = Conv2D(K.int_shape(x)[-1], (1, 1), **kwargs)(y) # 无激活函数 # 恢复原始特征的数量

y = Add()([x,y]) # Add the bypass connection

y = Activation('relu')(y)

return y

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

当然还有conv block如下图:

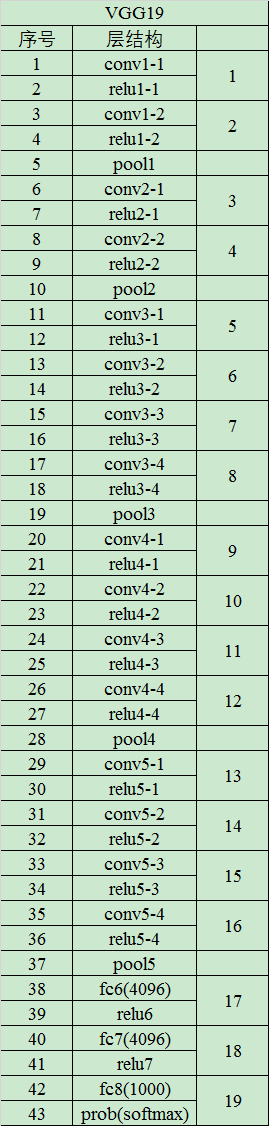

2、网络层数

我们所说的网络层数,主要指的是Conv的层和fc全连接层,如下图的VGG19网络

所属网站分类: 技术文章 > 博客

作者:83whjh

链接:https://www.pythonheidong.com/blog/article/48478/89185daac5af23228bf4/

来源:python黑洞网

任何形式的转载都请注明出处,如有侵权 一经发现 必将追究其法律责任

昵称:

评论内容:(最多支持255个字符)

---无人问津也好,技不如人也罢,你都要试着安静下来,去做自己该做的事,而不是让内心的烦躁、焦虑,坏掉你本来就不多的热情和定力